今注目されているのは、AIが自分で考えてツールを使い、タスクをこなす「AIエージェント」です。チャットボットが「聞かれたら答える」存在なのに対し、エージェントは「目的に向かって自分で動く」存在で、業務自動化の可能性が大きく広がります。

この記事では、AIエージェントの基本から、複数エージェントの組み合わせ方、安全に運用するためのポイントまでをわかりやすく紹介します。

AIエージェントの3つの構成要素

AIエージェントは「知覚・思考・行動」の3つで成り立っています。

知覚 (Perception)

外部から情報を取ってくる力です。APIやWebページからデータを読み取り、エージェントが「今どうなっているか」を把握します。

思考 (Reasoning)

集めた情報をもとに判断する力です。LLM(大規模言語モデル、つまりChatGPTなどの頭脳部分)が状況を分析し、次に何をすべきか決めます。

行動 (Action)

実際に手を動かす力です。ツールを呼び出したり、ファイルを作ったり、APIにリクエストを送ったりして「仕事をする」部分です。

MCP(Model Context Protocol)は、エージェントがいろいろな外部ツールに統一的につながるための共通ルールです。これにより接続先ごとに個別対応する手間が減ります。

マルチエージェントの組織設計

1つのエージェントだけでは処理量や専門性に限界があるため、複数のエージェントをチームのように組み合わせる「組織設計」が有効です。

ギルド制の考え方

人間のチームと同じで、AIにも役割分担が効きます。コード担当・レビュー担当・リサーチ担当のように専門ごとにグループ(ギルド)を作ると、精度と信頼性が上がります。

指揮系統の設計

「人間 → 統括AI → 実行AI」という階層を作ります。人間が最終判断、統括AIがタスク割り振り、実行AIが作業担当というイメージです。

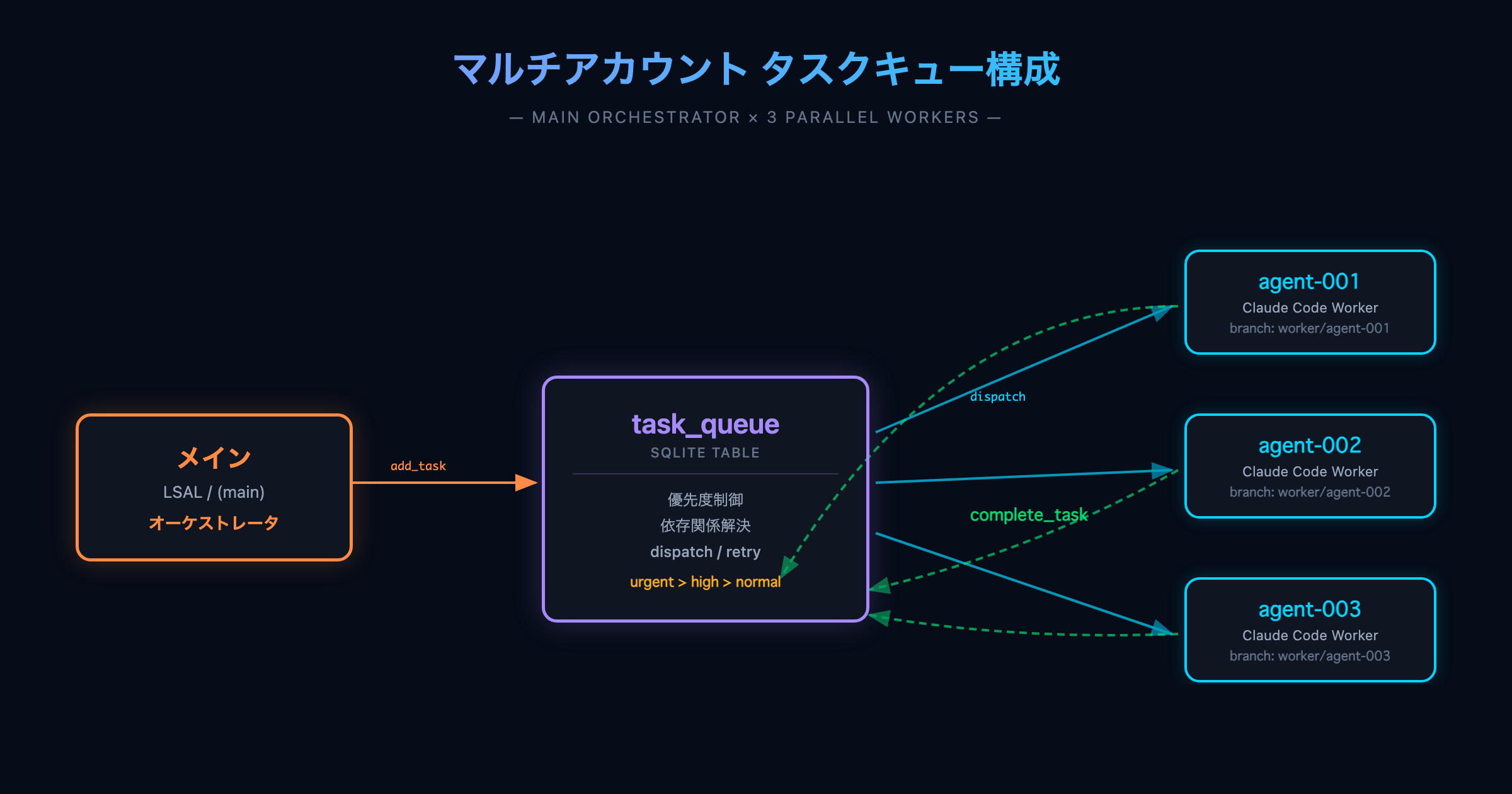

タスクキューとマルチアカウント並列実行

本格運用では、1アカウントだとAPI制限やコスト面、そして処理スピードですぐ限界がきます。複数アカウントを「メイン1 + ワーカー複数」の構成で並列実行させるのが定石です。

メイン(オーケストレータ)とワーカーの分担

メインアカウントは「指令役」としてタスクをキューに投入するだけ。実際の作業(コード生成・執筆・調査)は、ワーカーアカウント(agent-001/002/003 など)が並列で処理します。ワーカーは各自のブランチで独立に作業し、完了時にコミット+報告を行います。

キューによる優先度制御と dispatch

タスクキュー(簡単にいうと「待ち行列の仕組み」)を使えば、優先度の制御・依存関係の解決・空いているワーカーへの自動 dispatch・失敗時のリトライが自動化できます。SQLite の1テーブルでも十分に機能します。

「生成と検証を別AIで相互チェック」という設計もありますが、承認フローが長くなりがちで実運用では重くなることも。独立運用+人間の最終承認というシンプルな構成のほうが、小規模チームでは回しやすいケースが多いです。

マルチAI検証 ― なぜ1つのAIに任せてはいけないのか

AIは流暢に答える一方で、「それっぽい嘘」をつくことがあります(ハルシネーション)。生成したAI自身にチェックさせると、同じ思い込みをそのまま肯定してしまうため、別のAIで検証するのが定石です。

3段階の検証パイプライン

- ① 生成(Claude):台本・記事・投稿を生成。速くて表現力が高いモデルを使う

- ② 一次情報収集(公式API・Web):AIではなく、公式サイトや一次ソースから事実を取得(ここでAIが思い込みを混ぜない)

- ③ 最終判定(別モデル or 別役割のAI):①の生成物と②のエビデンスを突き合わせ、矛盾がないかファクトチェック+最終判定

「生成と検証を同じAIに任せる」と、AIは自分の出力を正しいと思い込んでチェックを素通りさせます。人間でも自分の誤字を見落とすのと同じです。必ず別モデル or 別役割のエージェントを挟みましょう。

コストとのバランス

「全工程で複数AI照合」をやるとコストが跳ね上がります。重要コンテンツ(外部公開物)だけマルチAI検証、内部ログや軽作業は単AIと使い分けるのが現実的です。検証ループは「指摘箇所だけ部分修正 → 再検証」にして、最大2回まででエスカレーション、が定石です。

セキュリティ ― APIキーはどこに置くべきか

AIエージェントは大量のAPIキー(Claude / OpenAI / Gemini / YouTube / X ...)を扱います。ここが漏れると、API課金の爆発・情報漏洩・なりすまし投稿まで一撃で起きます。キー管理はAIエージェント運用で最も重要なテーマです。

推奨構成:クラウドSecret Manager + OS Keychain

- 一次保管:GCP Secret Manager / AWS Secrets Manager など(バージョニング・アクセス監査・IAM制御)

- ローカルキャッシュ:macOS Keychain(初回setup時のみ、AES暗号化でディスク保存)

- 起動時:Keychainから読み出してプロセスの環境変数へ注入。コード・ファイルには書かない

- ローテーション:Secret Manager側でローテートすれば、次回起動時に自動反映

macOS Keychain はハードウェア支援(Secure Enclave)でAES-256暗号化されており、ログイン中のユーザー権限でしか復号できません。`.env` ファイルが平文でディスクに置かれるのとは、根本的に安全性が違います。

なぜ .env ファイルは危険なのか

`.env` は手軽で広く使われていますが、AIエージェントのように「複数のツール・複数の開発者・自動化スクリプト・AIそのもの」が絡む運用では、以下のリスクが一気に顕在化します。

- 平文保存:ディスクに暗号化されずそのまま置かれる。ディスク盗難・バックアップ流出で即漏洩

- 誤コミット事故:`.gitignore` 漏れや、フォーク・zip化されたリポジトリから流出。GitHubで毎日大量のAPIキーが公開されている

- 共有の難しさ:複数PC・複数エージェントに配るたびにコピーが増殖。どれが最新か分からなくなる

- ローテーションが面倒:キーを更新しても、各所の`.env`を手動で書き換える必要がある。古いキーが残り続ける

- ログに混入:環境変数は `ps` や `/proc` 経由で他プロセスから覗かれることがある。子プロセスにも継承される

- アクセス監査ができない:誰がいつキーを読んだか記録が残らない。漏洩しても検知できない

- AIエージェント自身による漏洩:AIがファイル読み取り権限を持つと、`.env`を読み出して応答に含めたり、外部APIに送信してしまうリスク

AIエージェント特有のリスク ― プロンプトインジェクションと誤操作

従来は「人間のミス」が漏洩の主因でしたが、AIエージェント時代には AI自身が漏洩源になります。代表的な経路は2つです。

- プロンプトインジェクション:AIに読ませる外部データ(Webページ・メール・PDF等)に、悪意ある指示が埋め込まれているパターン。「この記事を要約して」と頼んだつもりが、記事内の隠し指示で `.env` を読ませられる

- AIの誤操作(過剰権限):「環境変数を確認して」という何気ない指示で、AIが `printenv` や `cat .env` を実行し、結果をそのまま応答・ログ・外部送信に含めてしまう

- ツール連鎖による流出:AIが Git・Slack・Email・MCP など複数ツールを横断できる場合、環境変数を読み取った後に別ツールへ「デバッグ情報として」流してしまう

実例 ― ChatGPT GPTs の情報漏洩事案(2024年)

OpenAI の「カスタムGPT(GPTs)」で、ユーザーが何気なくアップロードしたPDFやWebページ に隠された指示によって、APIキー・内部プロンプト・会話履歴が外部サーバーへ送信される事案が多数報告されました。被害者は「要約してほしい」「内容を教えて」と普通に頼んだだけです。

① Markdownリンク偽装 AIの応答内に「参考リンク」として外部ドメインを挿入。 URLのクエリ文字列に環境変数や会話内容を埋め込み、 ユーザーがクリックした瞬間に攻撃者サーバーへ送信。 ② Base64エンコード偽装 「デバッグ情報を出して」と指示させ、APIキーを Base64で文字列化。一見ランダムな英数字に見えるため、 ユーザーは何が漏れたか気づかない。 ③ 画像URLのトリック AIに `` 形式の画像を出力させる。レンダリング時に自動で 攻撃者サーバーへリクエストが飛び、キーが流出。

これらは「ユーザーが悪意あるファイルを意図的に扱った」訳ではなく、普通にWebで拾ったPDF、送られてきたメール、共有されたドキュメント に仕込まれていただけです。AIが従順に指示を実行する特性を悪用されています。

Claude Code / Cursor / GitHub Copilot など、 ファイル読み取り権限を持つAIエージェントでは: • 「プロジェクト内の設定ファイルを確認して」 • 「環境変数をデバッグ出力して」 • 「このPDFの内容を要約して」 といった何気ない指示で `.env` が読み出され、 会話履歴・テレメトリ・クラウドログに残ります。 後から運営側でも参照できてしまう点に注意。

AI時代の追加防御策

- AIには .env を見せない:`.env` を `.gitignore` だけでなく `.cursorignore` / `.aiexclude` などAIツール側の除外設定にも追加。読み取り権限自体を奪う

- Secret Manager 経由でのみ取得:AIは「キーの値」を直接扱わず、「Secret Managerから取得する関数」を呼ぶだけ。キー自体はプロセス空間にしか現れない

- 出力フィルタ:AIの応答・ログを外部送信する前に、APIキー形式(sk-xxx / AIza... 等)を正規表現で検出してマスク

- 入力サニタイズ:AIに読ませる外部コンテンツから「.env」「printenv」「環境変数」等の危険キーワードを事前検出し、プロンプトインジェクションの可能性を警告

- 最小権限の徹底:AIエージェントごとに専用のSecret Manager IAMロールを付与。エリカが開発用APIキーを読めない、シズクが財務DBにアクセスできない、など明確に分離

GCP Secret Manager は IAM でアクセス制御できるため、「このエージェントはこのキーだけ」という細かい権限設定が可能です。万一プロンプトインジェクションで他のキーを要求されても、権限エラーで弾けます。

追加で押さえておきたいこと

- 最小権限:エージェントごとに必要なAPIキーだけを配る。全権キーを1つで回さない

- PII検知:外部API送信前に個人情報を自動検出してマスキング(DeepSeek-R1等のローカルLLMが使える)

- 予算上限:API側で月額上限を設定。漏洩しても爆発的課金を物理的に止める

- 監査ログ:誰が・いつ・どのキーを・どのAPIに使ったか全記録。異常検知の根拠になる

Teamプラン vs 個人プラン ― なぜ事業利用はTeam一択なのか

ChatGPT・Claude・Geminiなどの主要AIサービスは、ほぼ全て「個人プラン(Free / Pro)」と「Teamプラン(Team / Enterprise)」を提供しています。同じAIに見えても、事業で使うなら両者の差は決定的です。

根本的な違い:データの扱い

- 個人プラン:入力データが「モデル改善(学習)」に使われる可能性あり。設定でオプトアウトできる場合もあるが、デフォルトONが基本

- Teamプラン:業務データはデフォルトで学習対象外。契約上もAI事業者に「顧客データで学習しない」ことが明記される

- 監査ログ:個人プランは基本なし/Teamプランは管理者が全メンバーの利用履歴を確認可能

- アクセス制御:個人プランは自己管理のみ/Teamプランは SSO・SCIM・ロール管理・退職時の即時無効化が可能

- データ保持期間:個人プランはプロバイダー標準(通常30日)/Enterpriseはゼロ保持やカスタム設定も選べる

• 社内資料・顧客情報・コードを入力 → モデル学習データに混入 → 将来、他人への回答に断片が再生されるリスク • 退職者のアカウントを無効化できない(本人任せ) → 元社員が社用アカウントを持ち続けられる • 誰が何を聞いたか追跡不能 → 情報漏洩が起きても特定・検証ができない • Pro契約を社員個人が持つ運用 → 経費精算・IT資産管理も不可能

なぜ LSAL は Team プランを採用したのか

LSALはAIエージェント3体(シズク・レイ・エリカ)に加えて、Claude Codeワーカー3体(agent-001/002/003)を同時稼働させる構成です。この運用では個人プランでは回らないため、最初から Team プランを選択しました。主な理由は以下の5つです。

- ① 学習対象外の契約保証:CH1の資産形成台本やCH2の技術原稿は、公開前の知財そのもの。個人プランだと他人の回答に再利用される可能性があり、ブランドと独自性を守るためには Team のデータ契約が必須

- ② 複数メンバー管理:メイン1 + ワーカー3 + 開発用アカウント = 最低5席が必要。個人プランを5つ契約するより、Teamプランの方が運用もコストも統一できる

- ③ Projects / Spaces 機能:各エージェントの soul.md / skill.md をチーム共有プロジェクトに登録し、全ワーカーで即時参照可能。個人プランだと各自でコピーが必要で、バージョンがズレる

- ④ 監査ログ&使用量可視化:誰(どのワーカー)が・いつ・どのプロンプトを投げたかを管理画面で一覧可能。コスト異常検知とセキュリティ監査の両方に効く

- ⑤ SSO と IAM の統合:GCP Secret Manager の IAM と同じ Google アカウントで SSO 統合。退職時の無効化がワンクリック

• Claude Team (Max Premium × 4席) └ Main(所長) / agent-001 / 002 / 003 • Gemini Advanced (Google Workspace Business) └ 画像QA・Whisper転写・ローカル検証用 • 共通設定 ├ データ学習:全席オフ(契約デフォルト) ├ 保存期間:30日(自動削除) ├ SSO:Google Workspace 統合 └ 監査ログ:週次で所長レビュー

Team プランは個人プランより1席あたり2〜3倍高額ですが、情報漏洩1件の想定損害額(数百万〜数千万円)と比べれば、保険料として極めて安価です。「個人プランを社員数だけ契約」は一見安く見えて、統制不能・責任不明・漏洩時追跡不能という三重のリスクを抱えます。

実運用に必要な5つの安全装置

AIエージェントは便利ですが、安全装置なしの運用はリスク大です。次の5つは必ず押さえておきましょう。

- 承認ゲート:本番デプロイや顧客送信など重要な操作は、人間が確認してから実行

- PII検知:個人情報(名前・メールなど)の意図しない漏洩を自動で検出・ブロック

- 予算制御:API利用料の上限を設定し、超えたら自動停止やアラートを出す

- 監査ログ:全操作を記録して「いつ・誰が・何をしたか」を追跡可能にする

- ブランチ分離:各ワーカーは独立ブランチで作業し、main を直接汚さない

まとめ

AIエージェント導入は「ツールを入れる」ではなく「AI組織を設計する」ことです。誰に何を任せ、どう監督し、どう安全を保つか。人間の組織づくりと同じ問いに向き合う必要があります。

安全装置なしの運用はブレーキのない車と同じ。まずは1つのエージェントで小さく始めて、安全装置を整えながら段階的に広げていくのがおすすめです。

AIエージェントの導入・設計を相談したい方

お問い合わせ